| .. | ||

| heap-memory-functions | ||

| use-after-free | ||

| bins-and-memory-allocations.md | ||

| double-free.md | ||

| fast-bin-attack.md | ||

| heap-overflow.md | ||

| house-of-einherjar.md | ||

| house-of-force.md | ||

| house-of-lore.md | ||

| house-of-orange.md | ||

| house-of-rabbit.md | ||

| house-of-roman.md | ||

| house-of-spirit.md | ||

| large-bin-attack.md | ||

| off-by-one-overflow.md | ||

| overwriting-a-freed-chunk.md | ||

| README.md | ||

| tcache-bin-attack.md | ||

| unlink-attack.md | ||

| unsorted-bin-attack.md | ||

Tas de mémoire

Bases du tas

Le tas est essentiellement l'endroit où un programme pourra stocker des données lorsqu'il demande des données en appelant des fonctions telles que malloc, calloc... De plus, lorsque cette mémoire n'est plus nécessaire, elle est libérée en appelant la fonction free.

Comme le montre l'image ci-dessous, le tas se situe juste après le chargement du binaire en mémoire (vérifiez la section [heap]):

Allocation de morceaux de base

Lorsqu'il est demandé de stocker des données dans le tas, un espace du tas lui est alloué. Cet espace appartiendra à un compartiment et seul les données demandées + l'espace des en-têtes de compartiment + le décalage de la taille minimale du compartiment seront réservés pour le morceau. Le but est de réserver autant de mémoire que nécessaire sans compliquer la recherche de l'emplacement de chaque morceau. Pour cela, les informations de métadonnées du morceau sont utilisées pour savoir où se trouve chaque morceau utilisé/libre.

Il existe différentes façons de réserver l'espace principalement en fonction du compartiment utilisé, mais une méthodologie générale est la suivante :

- Le programme commence par demander une certaine quantité de mémoire.

- Si dans la liste des morceaux il y en a un assez grand pour répondre à la demande, il sera utilisé.

- Cela peut même signifier que partie du morceau disponible sera utilisée pour cette demande et le reste sera ajouté à la liste des morceaux.

- S'il n'y a pas de morceau disponible dans la liste mais qu'il reste de l'espace dans la mémoire allouée du tas, le gestionnaire de tas crée un nouveau morceau.

- S'il n'y a pas assez d'espace de tas pour allouer le nouveau morceau, le gestionnaire de tas demande au noyau d'étendre la mémoire allouée au tas et utilise ensuite cette mémoire pour générer le nouveau morceau.

- Si tout échoue,

mallocrenvoie null.

Notez que si la mémoire demandée dépasse un seuil, mmap sera utilisé pour mapper la mémoire demandée.

Arènes

Dans les applications multithread, le gestionnaire de tas doit prévenir les conditions de concurrence qui pourraient entraîner des plantages. Initialement, cela était fait en utilisant un mutex global pour garantir qu'un seul thread pouvait accéder au tas à la fois, mais cela causait des problèmes de performance en raison de l'engorgement induit par le mutex.

Pour remédier à cela, l'allocateur de tas ptmalloc2 a introduit des "arènes", où chaque arène agit comme un tas séparé avec ses propres structures de données et mutex, permettant à plusieurs threads d'effectuer des opérations de tas sans interférer les uns avec les autres, tant qu'ils utilisent des arènes différentes.

L'arène "principale" par défaut gère les opérations de tas pour les applications monofilament. Lorsque de nouveaux threads sont ajoutés, le gestionnaire de tas leur attribue des arènes secondaires pour réduire les conflits. Il tente d'abord d'attacher chaque nouveau thread à une arène inutilisée, en en créant de nouvelles si nécessaire, jusqu'à une limite de 2 fois le nombre de cœurs CPU pour les systèmes 32 bits et 8 fois pour les systèmes 64 bits. Une fois la limite atteinte, les threads doivent partager des arènes, entraînant des conflits potentiels.

Contrairement à l'arène principale, qui s'étend en utilisant l'appel système brk, les arènes secondaires créent des "sous-tas" en utilisant mmap et mprotect pour simuler le comportement du tas, permettant une flexibilité dans la gestion de la mémoire pour les opérations multithread.

Sous-tas

Les sous-tas servent de réserves de mémoire pour les arènes secondaires dans les applications multithread, leur permettant de croître et de gérer leurs propres régions de tas séparément du tas principal. Voici comment les sous-tas diffèrent du tas initial et comment ils fonctionnent :

- Tas initial vs. Sous-tas :

- Le tas initial se trouve directement après le binaire du programme en mémoire, et il s'étend en utilisant l'appel système

sbrk. - Les sous-tas, utilisés par les arènes secondaires, sont créés via

mmap, un appel système qui mappe une région mémoire spécifiée.

- Réservation de mémoire avec

mmap:

- Lorsque le gestionnaire de tas crée un sous-tas, il réserve un grand bloc de mémoire via

mmap. Cette réservation n'alloue pas immédiatement de mémoire ; elle désigne simplement une région que d'autres processus système ou allocations ne doivent pas utiliser. - Par défaut, la taille réservée pour un sous-tas est de 1 Mo pour les processus 32 bits et de 64 Mo pour les processus 64 bits.

- Expansion progressive avec

mprotect:

- La région mémoire réservée est initialement marquée comme

PROT_NONE, indiquant que le noyau n'a pas besoin d'allouer de mémoire physique à cet espace pour le moment. - Pour "étendre" le sous-tas, le gestionnaire de tas utilise

mprotectpour changer les autorisations de page dePROT_NONEàPROT_READ | PROT_WRITE, incitant le noyau à allouer de la mémoire physique aux adresses précédemment réservées. Cette approche étape par étape permet au sous-tas de s'étendre selon les besoins. - Une fois que tout le sous-tas est épuisé, le gestionnaire de tas crée un nouveau sous-tas pour continuer l'allocation.

heap_info

Cette structure alloue des informations pertinentes sur le tas. De plus, la mémoire du tas peut ne pas être continue après plusieurs allocations, cette structure stockera également ces informations.

// From https://github.com/bminor/glibc/blob/a07e000e82cb71238259e674529c37c12dc7d423/malloc/arena.c#L837

typedef struct _heap_info

{

mstate ar_ptr; /* Arena for this heap. */

struct _heap_info *prev; /* Previous heap. */

size_t size; /* Current size in bytes. */

size_t mprotect_size; /* Size in bytes that has been mprotected

PROT_READ|PROT_WRITE. */

size_t pagesize; /* Page size used when allocating the arena. */

/* Make sure the following data is properly aligned, particularly

that sizeof (heap_info) + 2 * SIZE_SZ is a multiple of

MALLOC_ALIGNMENT. */

char pad[-3 * SIZE_SZ & MALLOC_ALIGN_MASK];

} heap_info;

malloc_state

Chaque tas (arène principale ou arènes d'autres threads) a une structure malloc_state.

Il est important de noter que la structure malloc_state de l'arène principale est une variable globale dans la libc (donc située dans l'espace mémoire de la libc).

Dans le cas des structures malloc_state des tas des threads, elles sont situées à l'intérieur du "tas" du thread lui-même.

Il y a quelques choses intéressantes à noter à partir de cette structure (voir le code C ci-dessous) :

__libc_lock_define (, mutex);est là pour s'assurer que cette structure du tas est accédée par 1 thread à la fois- Drapeaux :

-

#define NONCONTIGUOUS_BIT (2U)

#define contiguous(M) (((M)->flags & NONCONTIGUOUS_BIT) == 0) #define noncontiguous(M) (((M)->flags & NONCONTIGUOUS_BIT) != 0) #define set_noncontiguous(M) ((M)->flags |= NONCONTIGUOUS_BIT) #define set_contiguous(M) ((M)->flags &= ~NONCONTIGUOUS_BIT)

* Le `mchunkptr bins[NBINS * 2 - 2];` contient des **pointeurs** vers les **premiers et derniers morceaux** des **bacs** petits, grands et non triés (le -2 est parce que l'index 0 n'est pas utilisé)

* Par conséquent, le **premier morceau** de ces bacs aura un **pointeur arrière vers cette structure** et le **dernier morceau** de ces bacs aura un **pointeur avant** vers cette structure. Ce qui signifie essentiellement que si vous pouvez **dévoiler ces adresses dans l'arène principale**, vous aurez un pointeur vers la structure dans la **libc**.

* Les structures `struct malloc_state *next;` et `struct malloc_state *next_free;` sont des listes chaînées d'arènes

* Le morceau `top` est le dernier "morceau", qui est essentiellement **tout l'espace restant du tas**. Une fois que le morceau `top` est "vide", le tas est complètement utilisé et il doit demander plus d'espace.

* Le morceau `last reminder` provient des cas où un morceau de taille exacte n'est pas disponible et donc un morceau plus grand est divisé, une partie restante du pointeur est placée ici.

```c

// From https://github.com/bminor/glibc/blob/a07e000e82cb71238259e674529c37c12dc7d423/malloc/malloc.c#L1812

struct malloc_state

{

/* Serialize access. */

__libc_lock_define (, mutex);

/* Flags (formerly in max_fast). */

int flags;

/* Set if the fastbin chunks contain recently inserted free blocks. */

/* Note this is a bool but not all targets support atomics on booleans. */

int have_fastchunks;

/* Fastbins */

mfastbinptr fastbinsY[NFASTBINS];

/* Base of the topmost chunk -- not otherwise kept in a bin */

mchunkptr top;

/* The remainder from the most recent split of a small request */

mchunkptr last_remainder;

/* Normal bins packed as described above */

mchunkptr bins[NBINS * 2 - 2];

/* Bitmap of bins */

unsigned int binmap[BINMAPSIZE];

/* Linked list */

struct malloc_state *next;

/* Linked list for free arenas. Access to this field is serialized

by free_list_lock in arena.c. */

struct malloc_state *next_free;

/* Number of threads attached to this arena. 0 if the arena is on

the free list. Access to this field is serialized by

free_list_lock in arena.c. */

INTERNAL_SIZE_T attached_threads;

/* Memory allocated from the system in this arena. */

INTERNAL_SIZE_T system_mem;

INTERNAL_SIZE_T max_system_mem;

};

malloc_chunk

Cette structure représente un morceau particulier de mémoire. Les différents champs ont des significations différentes pour les morceaux alloués et non alloués.

// https://github.com/bminor/glibc/blob/master/malloc/malloc.c

struct malloc_chunk {

INTERNAL_SIZE_T mchunk_prev_size; /* Size of previous chunk, if it is free. */

INTERNAL_SIZE_T mchunk_size; /* Size in bytes, including overhead. */

struct malloc_chunk* fd; /* double links -- used only if this chunk is free. */

struct malloc_chunk* bk;

/* Only used for large blocks: pointer to next larger size. */

struct malloc_chunk* fd_nextsize; /* double links -- used only if this chunk is free. */

struct malloc_chunk* bk_nextsize;

};

typedef struct malloc_chunk* mchunkptr;

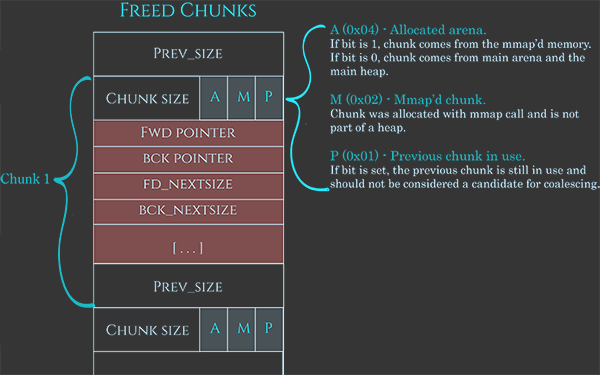

Comme commenté précédemment, ces chunks ont également des métadonnées, très bien représentées dans cette image :

https://azeria-labs.com/wp-content/uploads/2019/03/chunk-allocated-CS.png

Les métadonnées sont généralement 0x08B, indiquant la taille actuelle du chunk en utilisant les 3 derniers bits pour indiquer :

A: Si 1, il provient d'un sous-heap, si 0, il est dans l'arène principaleM: Si 1, ce chunk fait partie d'un espace alloué avec mmap et non d'un heapP: Si 1, le chunk précédent est en cours d'utilisation

Ensuite, l'espace pour les données utilisateur, et enfin 0x08B pour indiquer la taille du chunk précédent lorsque le chunk est disponible (ou pour stocker les données utilisateur lorsqu'il est alloué).

De plus, lorsque disponible, les données utilisateur sont également utilisées pour contenir certaines données :

fd: Pointeur vers le chunk suivantbk: Pointeur vers le chunk précédentfd_nextsize: Pointeur vers le premier chunk dans la liste qui est plus petit que lui-mêmebk_nextsize: Pointeur vers le premier chunk dans la liste qui est plus grand que lui-même

https://azeria-labs.com/wp-content/uploads/2019/03/chunk-allocated-CS.png

{% hint style="info" %} Notez comment aimer la liste de cette manière évite le besoin d'avoir un tableau où chaque chunk est enregistré individuellement. {% endhint %}

Pointeurs de Chunk

Lorsque malloc est utilisé, un pointeur vers le contenu qui peut être écrit est renvoyé (juste après les en-têtes), cependant, lors de la gestion des chunks, un pointeur vers le début des en-têtes (métadonnées) est nécessaire.

Pour ces conversions, ces fonctions sont utilisées :

// https://github.com/bminor/glibc/blob/master/malloc/malloc.c

/* Convert a chunk address to a user mem pointer without correcting the tag. */

#define chunk2mem(p) ((void*)((char*)(p) + CHUNK_HDR_SZ))

/* Convert a user mem pointer to a chunk address and extract the right tag. */

#define mem2chunk(mem) ((mchunkptr)tag_at (((char*)(mem) - CHUNK_HDR_SZ)))

/* The smallest possible chunk */

#define MIN_CHUNK_SIZE (offsetof(struct malloc_chunk, fd_nextsize))

/* The smallest size we can malloc is an aligned minimal chunk */

#define MINSIZE \

(unsigned long)(((MIN_CHUNK_SIZE+MALLOC_ALIGN_MASK) & ~MALLOC_ALIGN_MASK))

Alignement et taille minimale

Le pointeur vers le chunk et 0x0f doivent être égaux à 0.

// From https://github.com/bminor/glibc/blob/a07e000e82cb71238259e674529c37c12dc7d423/sysdeps/generic/malloc-size.h#L61

#define MALLOC_ALIGN_MASK (MALLOC_ALIGNMENT - 1)

// https://github.com/bminor/glibc/blob/a07e000e82cb71238259e674529c37c12dc7d423/sysdeps/i386/malloc-alignment.h

#define MALLOC_ALIGNMENT 16

// https://github.com/bminor/glibc/blob/master/malloc/malloc.c

/* Check if m has acceptable alignment */

#define aligned_OK(m) (((unsigned long)(m) & MALLOC_ALIGN_MASK) == 0)

#define misaligned_chunk(p) \

((uintptr_t)(MALLOC_ALIGNMENT == CHUNK_HDR_SZ ? (p) : chunk2mem (p)) \

& MALLOC_ALIGN_MASK)

/* pad request bytes into a usable size -- internal version */

/* Note: This must be a macro that evaluates to a compile time constant

if passed a literal constant. */

#define request2size(req) \

(((req) + SIZE_SZ + MALLOC_ALIGN_MASK < MINSIZE) ? \

MINSIZE : \

((req) + SIZE_SZ + MALLOC_ALIGN_MASK) & ~MALLOC_ALIGN_MASK)

/* Check if REQ overflows when padded and aligned and if the resulting

value is less than PTRDIFF_T. Returns the requested size or

MINSIZE in case the value is less than MINSIZE, or 0 if any of the

previous checks fail. */

static inline size_t

checked_request2size (size_t req) __nonnull (1)

{

if (__glibc_unlikely (req > PTRDIFF_MAX))

return 0;

/* When using tagged memory, we cannot share the end of the user

block with the header for the next chunk, so ensure that we

allocate blocks that are rounded up to the granule size. Take

care not to overflow from close to MAX_SIZE_T to a small

number. Ideally, this would be part of request2size(), but that

must be a macro that produces a compile time constant if passed

a constant literal. */

if (__glibc_unlikely (mtag_enabled))

{

/* Ensure this is not evaluated if !mtag_enabled, see gcc PR 99551. */

asm ("");

req = (req + (__MTAG_GRANULE_SIZE - 1)) &

~(size_t)(__MTAG_GRANULE_SIZE - 1);

}

return request2size (req);

}

Obtenir les données du chunk et modifier les métadonnées

Ces fonctions fonctionnent en recevant un pointeur vers un chunk et sont utiles pour vérifier/définir les métadonnées :

- Vérifier les indicateurs du chunk

// From https://github.com/bminor/glibc/blob/master/malloc/malloc.c

/* size field is or'ed with PREV_INUSE when previous adjacent chunk in use */

#define PREV_INUSE 0x1

/* extract inuse bit of previous chunk */

#define prev_inuse(p) ((p)->mchunk_size & PREV_INUSE)

/* size field is or'ed with IS_MMAPPED if the chunk was obtained with mmap() */

#define IS_MMAPPED 0x2

/* check for mmap()'ed chunk */

#define chunk_is_mmapped(p) ((p)->mchunk_size & IS_MMAPPED)

/* size field is or'ed with NON_MAIN_ARENA if the chunk was obtained

from a non-main arena. This is only set immediately before handing

the chunk to the user, if necessary. */

#define NON_MAIN_ARENA 0x4

/* Check for chunk from main arena. */

#define chunk_main_arena(p) (((p)->mchunk_size & NON_MAIN_ARENA) == 0)

/* Mark a chunk as not being on the main arena. */

#define set_non_main_arena(p) ((p)->mchunk_size |= NON_MAIN_ARENA)

- Tailles et pointeurs vers d'autres morceaux

/*

Bits to mask off when extracting size

Note: IS_MMAPPED is intentionally not masked off from size field in

macros for which mmapped chunks should never be seen. This should

cause helpful core dumps to occur if it is tried by accident by

people extending or adapting this malloc.

*/

#define SIZE_BITS (PREV_INUSE | IS_MMAPPED | NON_MAIN_ARENA)

/* Get size, ignoring use bits */

#define chunksize(p) (chunksize_nomask (p) & ~(SIZE_BITS))

/* Like chunksize, but do not mask SIZE_BITS. */

#define chunksize_nomask(p) ((p)->mchunk_size)

/* Ptr to next physical malloc_chunk. */

#define next_chunk(p) ((mchunkptr) (((char *) (p)) + chunksize (p)))

/* Size of the chunk below P. Only valid if !prev_inuse (P). */

#define prev_size(p) ((p)->mchunk_prev_size)

/* Set the size of the chunk below P. Only valid if !prev_inuse (P). */

#define set_prev_size(p, sz) ((p)->mchunk_prev_size = (sz))

/* Ptr to previous physical malloc_chunk. Only valid if !prev_inuse (P). */

#define prev_chunk(p) ((mchunkptr) (((char *) (p)) - prev_size (p)))

/* Treat space at ptr + offset as a chunk */

#define chunk_at_offset(p, s) ((mchunkptr) (((char *) (p)) + (s)))

- Insue bit

/* extract p's inuse bit */

#define inuse(p) \

((((mchunkptr) (((char *) (p)) + chunksize (p)))->mchunk_size) & PREV_INUSE)

/* set/clear chunk as being inuse without otherwise disturbing */

#define set_inuse(p) \

((mchunkptr) (((char *) (p)) + chunksize (p)))->mchunk_size |= PREV_INUSE

#define clear_inuse(p) \

((mchunkptr) (((char *) (p)) + chunksize (p)))->mchunk_size &= ~(PREV_INUSE)

/* check/set/clear inuse bits in known places */

#define inuse_bit_at_offset(p, s) \

(((mchunkptr) (((char *) (p)) + (s)))->mchunk_size & PREV_INUSE)

#define set_inuse_bit_at_offset(p, s) \

(((mchunkptr) (((char *) (p)) + (s)))->mchunk_size |= PREV_INUSE)

#define clear_inuse_bit_at_offset(p, s) \

(((mchunkptr) (((char *) (p)) + (s)))->mchunk_size &= ~(PREV_INUSE))

- Définir l'en-tête et le pied de page (lorsque les numéros de chunk sont en cours d'utilisation)

/* Set size at head, without disturbing its use bit */

#define set_head_size(p, s) ((p)->mchunk_size = (((p)->mchunk_size & SIZE_BITS) | (s)))

/* Set size/use field */

#define set_head(p, s) ((p)->mchunk_size = (s))

/* Set size at footer (only when chunk is not in use) */

#define set_foot(p, s) (((mchunkptr) ((char *) (p) + (s)))->mchunk_prev_size = (s))

- Obtenir la taille des données réellement utilisables à l'intérieur du chunk

#pragma GCC poison mchunk_size

#pragma GCC poison mchunk_prev_size

/* This is the size of the real usable data in the chunk. Not valid for

dumped heap chunks. */

#define memsize(p) \

(__MTAG_GRANULE_SIZE > SIZE_SZ && __glibc_unlikely (mtag_enabled) ? \

chunksize (p) - CHUNK_HDR_SZ : \

chunksize (p) - CHUNK_HDR_SZ + (chunk_is_mmapped (p) ? 0 : SIZE_SZ))

/* If memory tagging is enabled the layout changes to accommodate the granule

size, this is wasteful for small allocations so not done by default.

Both the chunk header and user data has to be granule aligned. */

_Static_assert (__MTAG_GRANULE_SIZE <= CHUNK_HDR_SZ,

"memory tagging is not supported with large granule.");

static __always_inline void *

tag_new_usable (void *ptr)

{

if (__glibc_unlikely (mtag_enabled) && ptr)

{

mchunkptr cp = mem2chunk(ptr);

ptr = __libc_mtag_tag_region (__libc_mtag_new_tag (ptr), memsize (cp));

}

return ptr;

}

Exemples

Exemple rapide de tas

Exemple rapide de tas provenant de https://guyinatuxedo.github.io/25-heap/index.html mais en arm64 :

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

void main(void)

{

char *ptr;

ptr = malloc(0x10);

strcpy(ptr, "panda");

}

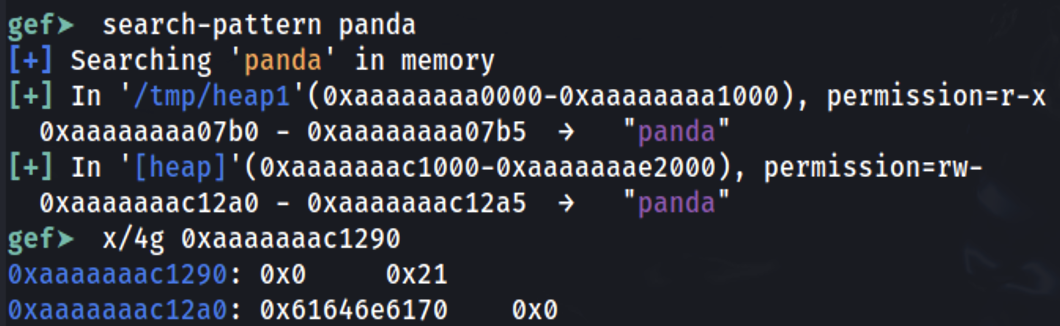

Placez un point d'arrêt à la fin de la fonction principale et découvrons où les informations ont été stockées :

Il est possible de voir que la chaîne panda a été stockée à 0xaaaaaaac12a0 (qui était l'adresse donnée en réponse par malloc à l'intérieur de x0). En vérifiant les 0x10 octets avant, il est possible de voir que le 0x0 représente que le chunk précédent n'est pas utilisé (longueur 0) et que la longueur de ce chunk est 0x21.

Les espaces supplémentaires réservés (0x21-0x10=0x11) proviennent des en-têtes ajoutés (0x10) et 0x1 ne signifie pas qu'il a été réservé 0x21B mais les 3 derniers bits de la longueur de l'en-tête actuel ont des significations spéciales. Comme la longueur est toujours alignée sur 16 octets (sur les machines 64 bits), ces bits ne seront en réalité jamais utilisés par le nombre de longueur.

0x1: Previous in Use - Specifies that the chunk before it in memory is in use

0x2: Is MMAPPED - Specifies that the chunk was obtained with mmap()

0x4: Non Main Arena - Specifies that the chunk was obtained from outside of the main arena

Exemple de multithreading

Multithread

```c #include #include #include #include #include <sys/types.h>void* threadFuncMalloc(void* arg) { printf("Hello from thread 1\n"); char* addr = (char*) malloc(1000); printf("After malloc and before free in thread 1\n"); free(addr); printf("After free in thread 1\n"); }

void* threadFuncNoMalloc(void* arg) { printf("Hello from thread 2\n"); }

int main() { pthread_t t1; void* s; int ret; char* addr;

printf("Before creating thread 1\n"); getchar(); ret = pthread_create(&t1, NULL, threadFuncMalloc, NULL); getchar();

printf("Before creating thread 2\n"); ret = pthread_create(&t1, NULL, threadFuncNoMalloc, NULL);

printf("Before exit\n"); getchar();

return 0; }

</details>

En déboguant l'exemple précédent, il est possible de voir qu'au début il n'y a qu'une seule arène :

<figure><img src="../../.gitbook/assets/image (1).png" alt=""><figcaption></figcaption></figure>

Ensuite, après avoir appelé le premier thread, celui qui appelle malloc, une nouvelle arène est créée :

<figure><img src="../../.gitbook/assets/image (1) (1).png" alt=""><figcaption></figcaption></figure>

et à l'intérieur, on peut trouver quelques chunks :

<figure><img src="../../.gitbook/assets/image (2).png" alt=""><figcaption></figcaption></figure>

## Bacs & Allocs/Libérations de Mémoire

Vérifiez quels sont les bacs et comment ils sont organisés, ainsi que la manière dont la mémoire est allouée et libérée dans :

{% content-ref url="bins-and-memory-allocations.md" %}

[bins-and-memory-allocations.md](bins-and-memory-allocations.md)

{% endcontent-ref %}

## Contrôles de Sécurité des Fonctions de la Heap

Les fonctions impliquées dans la heap effectueront certaines vérifications avant d'effectuer leurs actions pour essayer de s'assurer que la heap n'a pas été corrompue :

{% content-ref url="heap-memory-functions/heap-functions-security-checks.md" %}

[heap-functions-security-checks.md](heap-memory-functions/heap-functions-security-checks.md)

{% endcontent-ref %}

## Références

* [https://azeria-labs.com/heap-exploitation-part-1-understanding-the-glibc-heap-implementation/](https://azeria-labs.com/heap-exploitation-part-1-understanding-the-glibc-heap-implementation/)

* [https://azeria-labs.com/heap-exploitation-part-2-glibc-heap-free-bins/](https://azeria-labs.com/heap-exploitation-part-2-glibc-heap-free-bins/)